En mars 2016, Microsoft mit sur le marché un dialogueur ou agent conversationnel, en anglais un « chatbot » : un logiciel capable de s’entretenir « intelligemment » avec ses utilisateurs. Son nom était Tay, pour thinking about you : « Je pense à vous. » Tay était en fait la réédition d’un projet lancé par le même géant de l’informatique en Chine sous le nom de Xiaoice. Le logiciel était considéré là-bas comme une réussite, ayant tenu plus de 40 millions de conversations avec ses usagers.Au bout de seulement seize heur...

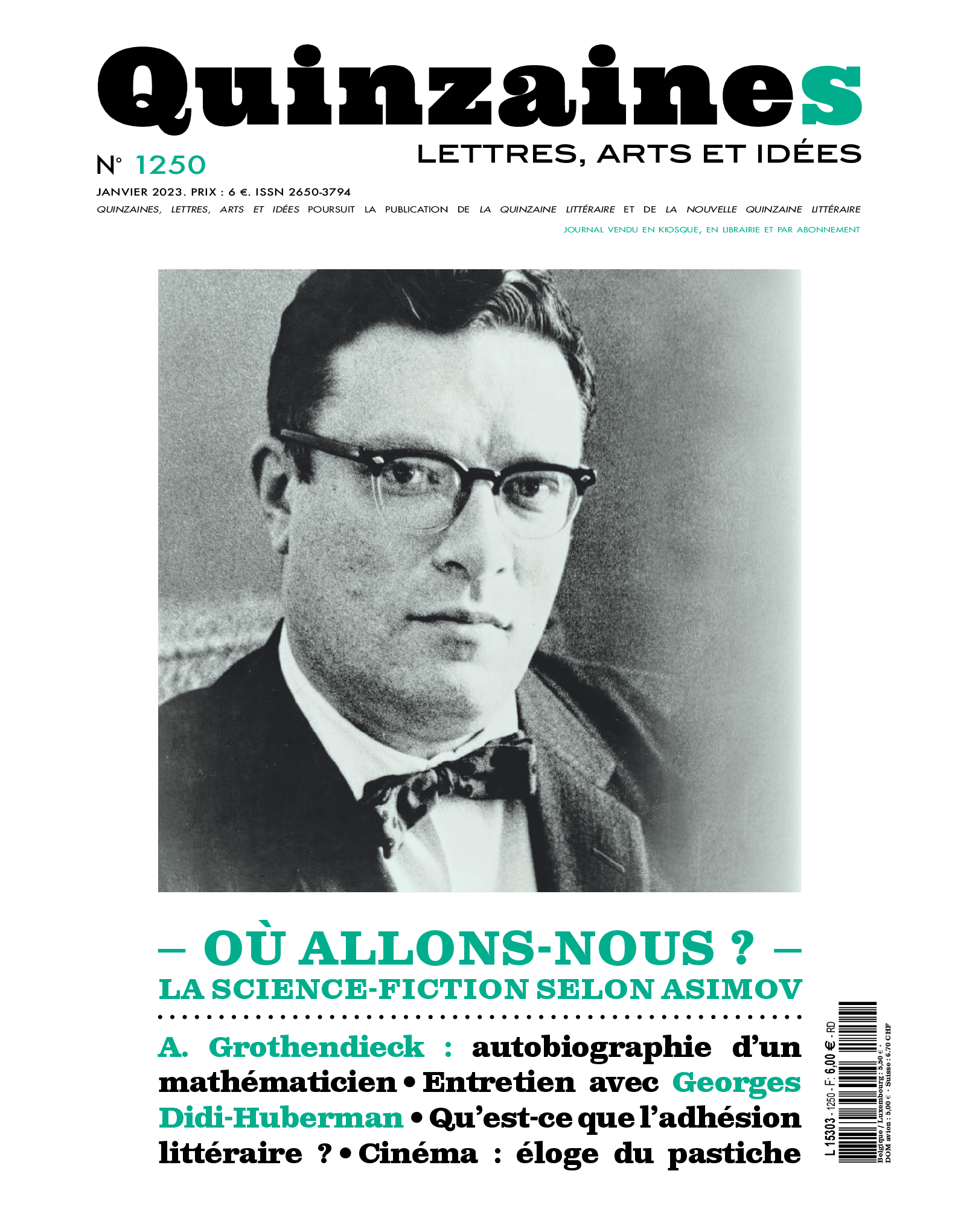

Les lois de la robotique d’Asimov : quels enjeux aujourd’hui ?

Article publié dans le n°1250 (29 janv. 2023) de Quinzaines

Commentaires (identifiez-vous pour commenter)